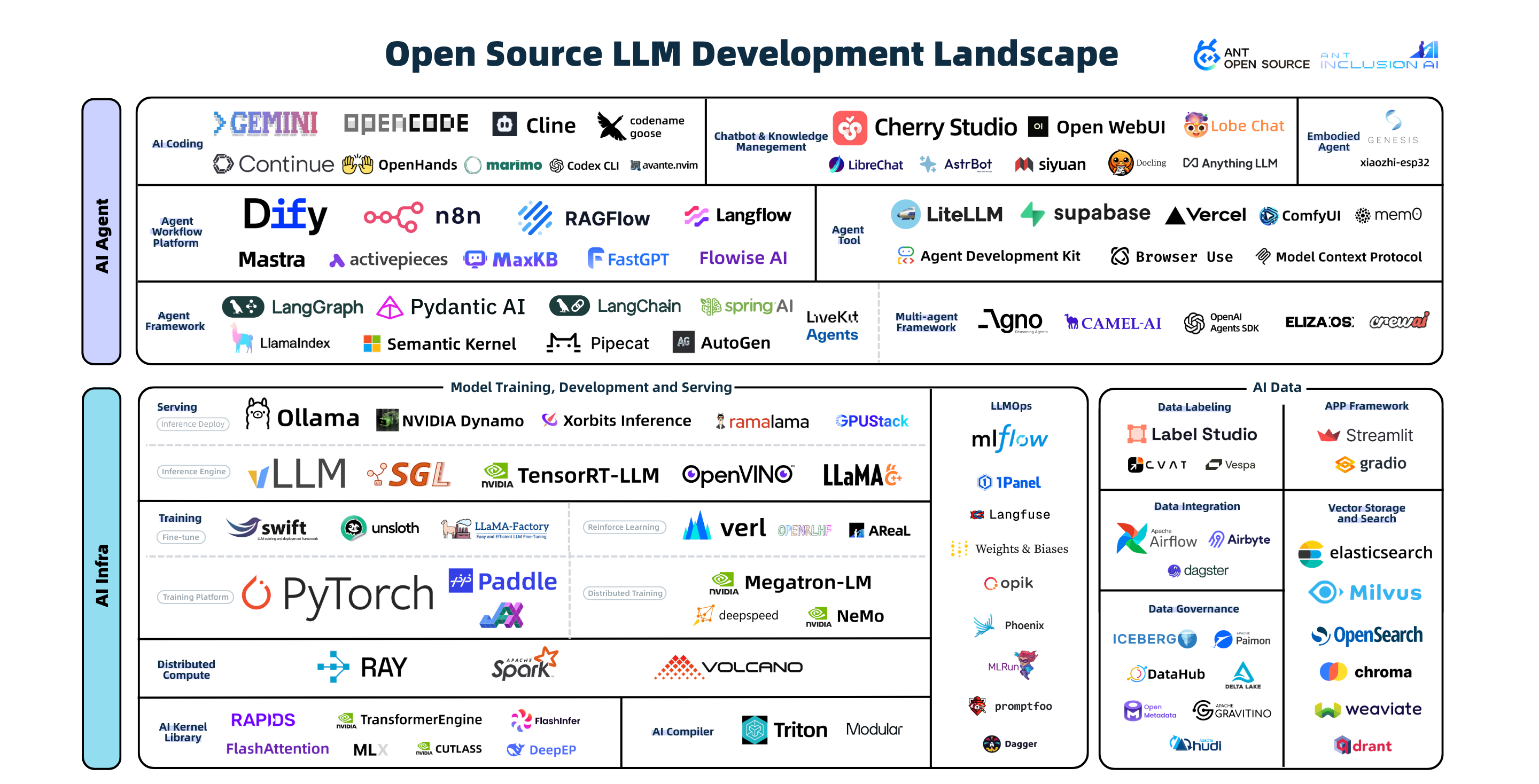

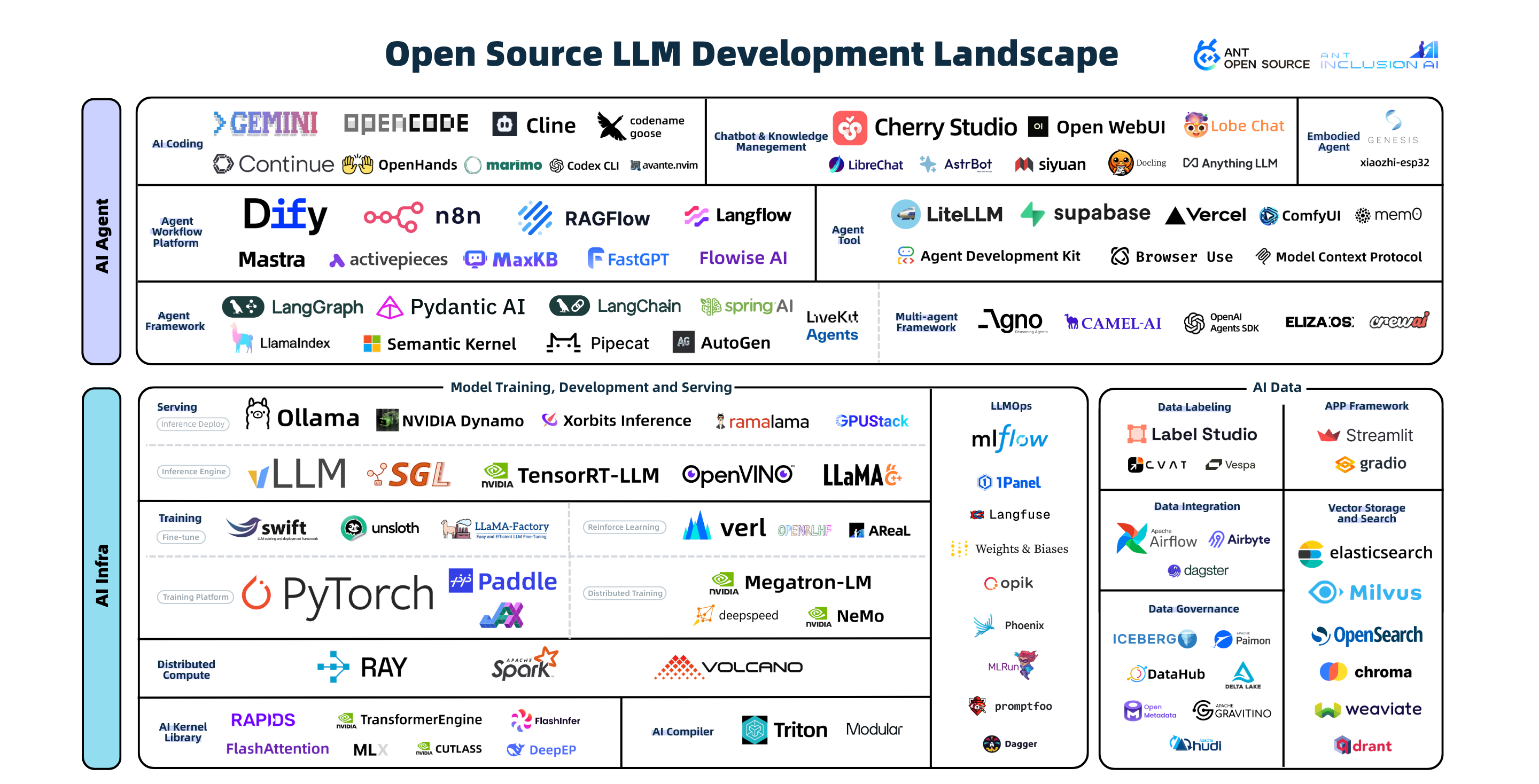

Open Source LLM Development Landscape解读

Open Source LLM Development Landscape 展示了开源 LLM 生态系统的全景,涵盖了从 AI 代理到 AI 基础设施的各个环节。本文将详细介绍图中的各个项目,并对相同类型的项目进行对比分析。

一、AI Agent(人工智能代理)

1. AI Coding(AI编程)

| 项目 |

简介 |

官网/Github |

特点 |

| GEMINI |

Google 推出的多模态大模型,支持文本、图像等输入 |

Google AI |

支持多模态输入,强大的语言理解和生成能力 |

| OPENCODE |

开源代码生成工具,用于辅助编程 |

Github Github |

提供代码生成和补全功能 |

| Cline |

基于 LLM 的代码生成和补全工具 |

Github |

支持多种编程语言的代码生成 |

| codename goose |

实验性项目,可能与代码生成或 AI 编程相关 |

Github |

专注于代码生成和自动化 |

| Continue |

提供代码补全和生成功能的插件 |

Github |

支持多种 IDE,可自定义模型 |

| OpenHands |

开源的 AI 编程助手,支持自动化代码生成 |

Github |

专注于软件开发任务自动化 |

| marimo |

用于数据科学和机器学习的交互式 Python 环境 |

官网 |

支持实时代码执行和可视化 |

| Codex CLI |

GitHub Copilot 的命令行接口 |

Github |

通过命令行使用GitHub Copilot |

| avante.nvim |

Neovim 插件,集成 AI 助手进行代码编写 |

Github |

为Neovim用户提供AI编程辅助 |

| Cherry Studio |

AI 工具平台,支持聊天机器人和知识管理 |

官网 |

提供AI应用开发和管理功能 |

| Open WebUI |

开源的 Web UI,用于访问和管理 LLM |

Github |

用户友好的界面,支持多种模型 |

| Lobe Chat |

轻量级的 AI 聊天应用 |

Github |

现代化界面,支持插件扩展 |

| GENESIS |

专注于 AI 代理的框架 |

Github |

提供AI代理开发框架 |

| xiaozi-esp32 |

基于 ESP32 的嵌入式 AI 代理 |

Github |

为ESP32设备提供AI代理功能 |

| 项目 |

简介 |

官网/Github |

特点 |

| Dify |

低代码平台,用于构建 AI 应用 |

Github |

一站式LLM应用开发平台,支持Agent、聊天机器人和工作流 |

| n8n |

开源的工作流自动化工具 |

Github |

连接不同系统,实现自动化操作 |

| RAGFlow |

基于检索增强生成(RAG)的工作流平台 |

Github |

深度集成RAG技术的知识库平台 |

| Langflow |

可视化工具,用于构建 LLM 应用 |

Github |

基于LangChain的可视化工作流编辑器 |

| LiteLLM |

轻量级的 LLM 接口库 |

Github |

统一接口访问各种大语言模型 |

| supabase |

后端即服务(BaaS)平台,支持 AI 集成 |

Github |

开源的 Firebase 替代品 |

| Vercel |

云平台,支持 AI 应用部署 |

官网 |

专注于前端和全栈应用部署 |

| ComfyUI |

用于构建 AI 工作流的图形化界面 |

Github |

专为 Stable Diffusion 设计的节点式界面 |

| mem0 |

用于 AI 代理的记忆系统 |

Github |

提供AI代理的记忆存储和检索功能 |

| Mастра |

AI 代理平台 |

Github |

提供AI代理开发和管理功能 |

| activepieces |

自动化平台,支持 AI 集成 |

官网 |

支持AI集成的自动化平台 |

| MaxKB |

知识库管理系统 |

官网 |

提供知识库管理和问答功能 |

| FastGPT |

快速构建 GPT 应用的平台 |

Github |

基于 FastGPT 的知识库问答系统 |

| Flowise AI |

用于构建 AI 应用的可视化工具 |

Github |

基于 LangChain 的低代码 UI |

| Agent Development Kit |

用于开发 AI 代理的工具包 |

官网 |

提供AI代理开发所需工具 |

| Browser Use |

浏览器扩展,用于 AI 代理 |

Github |

提供浏览器中的AI代理功能 |

| Model Context Protocol |

用于模型上下文管理的协议 |

官网 |

提供模型上下文管理标准 |

工作流平台对比分析

| 对比维度 |

Dify |

n8n |

Langflow |

| 核心定位 |

AI 应用开发平台 |

工作流自动化工具 |

LLM 应用可视化构建工具 |

| 主要特点 |

一站式LLM应用开发,支持Agent、聊天机器人和工作流 |

连接不同系统,实现自动化操作 |

基于LangChain的可视化工作流编辑 |

| 适用场景 |

构建AI应用,如智能客服、知识库问答 |

系统间自动化流程,如数据同步、通知发送 |

LLM应用原型设计和快速开发 |

| 技术重点 |

LLM模型管理、Prompt优化、RAG |

API集成、数据流转 |

LangChain集成、可视化流程设计 |

| 用户群体 |

AI开发者、产品经理、非技术用户 |

开发者、运维、业务整合团队 |

AI开发者、数据科学家 |

| 上手难度 |

低 |

中等 |

中等 |

3. Agent Framework(代理框架)

Agent框架对比分析

| 对比维度 |

LangChain |

AutoGen |

Semantic Kernel |

| 核心定位 |

通用级AI编排框架 |

多智能体对话框架 |

企业级Agent SDK |

| 主要特点 |

模块化设计,生态系统完善 |

多Agent协作,对话编程 |

与微软技术栈深度集成 |

| 适用场景 |

复杂AI应用开发 |

多Agent协作任务 |

企业系统集成 |

| 技术重点 |

Chain和Agent模式,丰富的工具链 |

多Agent对话和协作 |

技能和规划器模式 |

| 用户群体 |

AI开发者、后端工程师 |

AI研究者、开发者 |

企业开发者、.NET开发者 |

| 上手难度 |

中等 |

较高 |

中等 |

二、AI Infra(人工智能基础设施)

1. Model Training, Development and Serving(模型训练、开发和服务)

Serving(服务)

| 项目 |

简介 |

官网/Github |

特点 |

| ollama |

本地运行 LLM 的工具 |

Github |

轻量级本地推理平台 |

| NVIDIA Dynamo |

NVIDIA 提供的推理优化工具 |

|

|

| Xorbits Inference |

推理引擎 |

|

|

| ramalama |

LLM 推理框架 |

|

|

| GPUStack |

GPU 资源管理工具 |

|

|

| LLM |

通用的 LLM 推理框架 |

|

|

| SGL |

推理引擎 |

|

|

| TensorRT-LLM |

NVIDIA 提供的高性能推理引擎 |

Github |

针对NVIDIA GPU优化的推理框架 |

| OpenVINO |

Intel 提供的推理优化工具 |

Github |

针对Intel硬件优化 |

| LLaMA |

Meta 开源的 LLM 模型 |

|

|

Training(训练)

Distributed Compute(分布式计算)

| 项目 |

简介 |

官网/Github |

特点 |

| RAY |

分布式计算框架 |

Github |

简单易用的分布式计算框架 |

| Spark |

Apache Spark,用于大规模数据处理 |

官网 |

大数据处理的事实标准 |

| VOLCANO |

分布式计算框架 |

|

|

AI Kernel Library(AI内核库)

AI Compiler(AI编译器)

| 项目 |

简介 |

官网/Github |

特点 |

| Triton |

用于 GPU 编程的编译器 |

Github |

OpenAI开发的类Python语言 |

| Modular |

模块化的 AI 编译器 |

|

|

模型服务框架对比分析

| 对比维度 |

Ollama |

TensorRT-LLM |

| 核心定位 |

轻量级本地推理平台 |

NVIDIA高性能推理引擎 |

| 主要特点 |

易于部署,支持多种模型 |

针对NVIDIA GPU优化,性能极致 |

| 适用场景 |

个人开发者,本地测试 |

企业级应用,高性能需求 |

| 技术重点 |

简化部署流程 |

硬件级优化 |

| 硬件支持 |

CPU/GPU通用 |

仅限NVIDIA GPU |

| 上手难度 |

极低 |

较高 |

2. LLMOps(LLM 运维)

3. AI Data(AI 数据)

Data Labeling(数据标注)

Data Integration(数据集成)

Data Governance(数据治理)

| 项目 |

简介 |

官网/Github |

特点 |

| ICEBERG |

数据湖格式 |

|

|

| Paimon |

数据湖存储系统 |

|

|

| DataHub |

数据治理平台 |

Github |

LinkedIn开源的数据治理平台 |

| Delta Lake |

数据湖存储系统 |

|

|

| Open Metadata |

元数据管理工具 |

|

|

| GRAVITINO |

数据治理工具 |

|

|

| Shu6i |

数据治理工具 |

|

|

Vector Storage and Search(向量存储和搜索)

APP Framework(应用框架)

总结

Open Source LLM Development Landscape 全面展示了开源 LLM 生态系统的各个组成部分,从 AI 代理到 AI 基础设施,涵盖了从模型训练、推理、部署到数据管理和应用开发的各个环节。每个项目都有其特定的功能和应用场景,共同构成了一个完整的开源 LLM 开发生态。

选择合适的工具需要根据具体需求来决定:

- 对于AI应用开发,可以根据是否需要多Agent协作选择LangChain或AutoGen

- 对于模型服务,个人开发者可选择Ollama,企业级应用可选择TensorRT-LLM

- 对于工作流平台,构建AI应用可选择Dify,系统集成可选择n8n

- 对于基础设施,训练可选择PyTorch,推理优化可选择TensorRT-LLM或OpenVINO

这些项目共同构成了一个丰富的生态系统,为开发者提供了多种选择来构建和部署AI应用.